GPTDAOCN-e/acc on Nostr: и§Јз ҒзҘһз»ҸзҪ‘з»ңи®ӯз»ғпјҡж·ұе…ҘзҗҶи§ЈеүҚеҗ‘дёҺеҸҚеҗ‘дј ж’ӯзҡ„еҘҘз§ҳ ...

и§Јз ҒзҘһз»ҸзҪ‘з»ңи®ӯз»ғпјҡж·ұе…ҘзҗҶи§ЈеүҚеҗ‘дёҺеҸҚеҗ‘дј ж’ӯзҡ„еҘҘз§ҳ

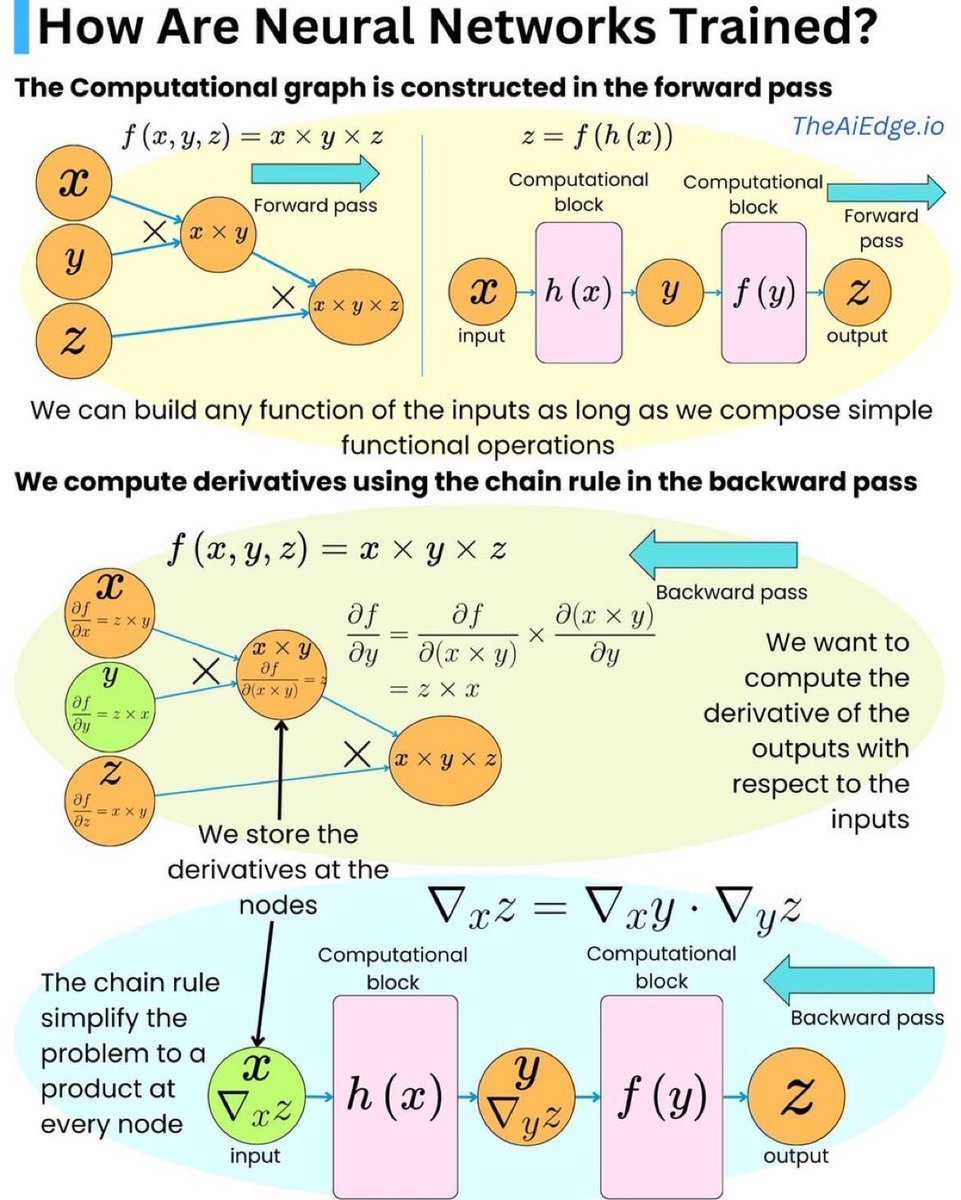

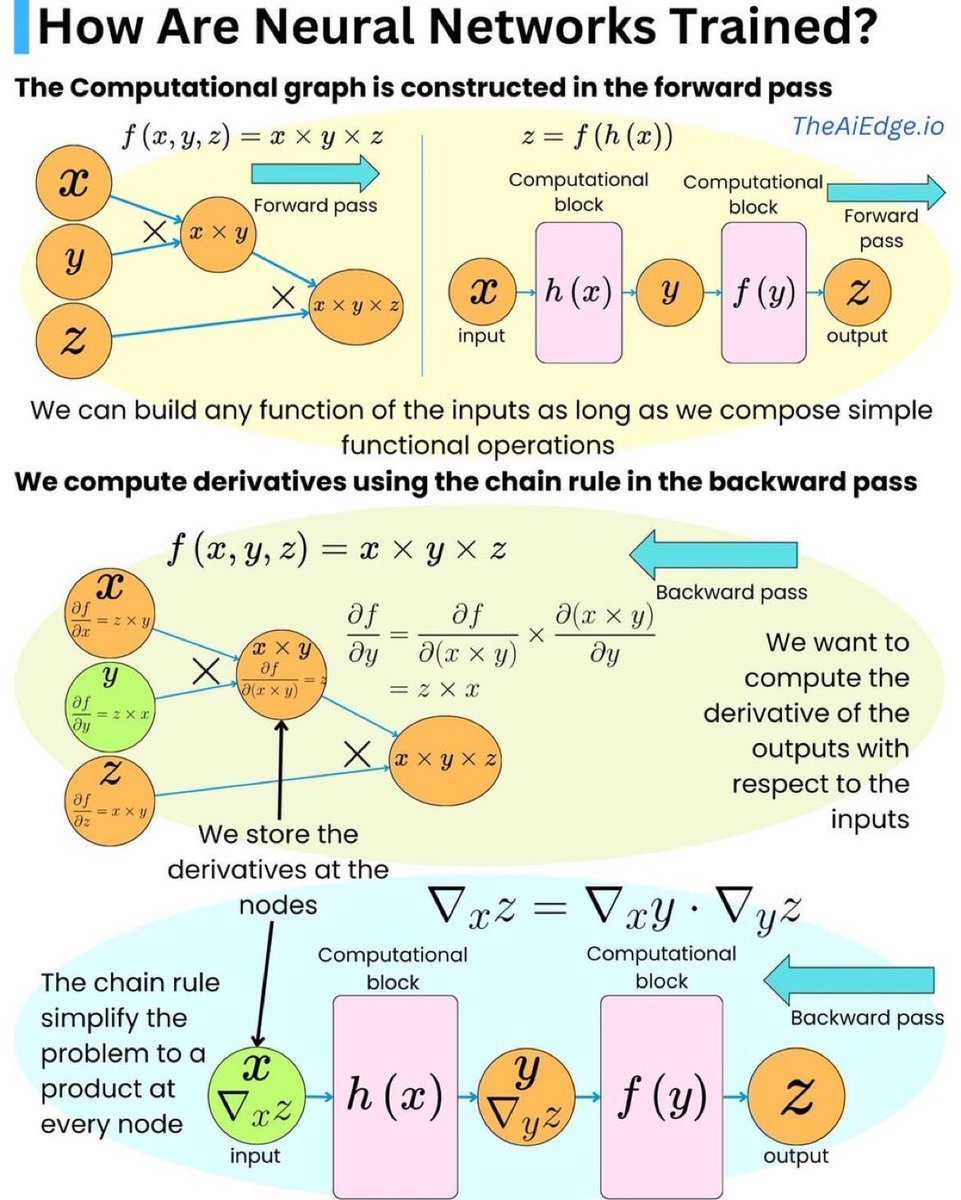

иҝҷеј еӣҫи§ЈйҮҠдәҶзҘһз»ҸзҪ‘з»ңжҳҜеҰӮдҪ•и®ӯз»ғзҡ„пјҢз®ҖеҚ•жқҘиҜҙе°ұжҳҜйҖҡиҝҮеүҚеҗ‘дј ж’ӯе’ҢеҸҚеҗ‘дј ж’ӯдёӨдёӘжӯҘйӘӨжқҘе®ҢжҲҗзҡ„гҖӮ

еүҚеҗ‘дј ж’ӯпјҲForward Passпјү

- жҰӮеҝөпјҡи®Ўз®—иҫ“еҮәз»“жһңгҖӮ

- иҝҮзЁӢпјҡ

1. иҫ“е…ҘпјҲx, y, zпјүйҖҡиҝҮдёҖзі»еҲ—и®Ўз®—жӯҘйӘӨгҖӮ

2. жҜҸдёҖжӯҘз”Ёз®ҖеҚ•зҡ„ж•°еӯҰж“ҚдҪңпјҢжҜ”еҰӮд№ҳжі•гҖӮ

3. еҫ—еҲ°жңҖз»Ҳиҫ“еҮәгҖӮ

еҸҚеҗ‘дј ж’ӯпјҲBackward Passпјү

- жҰӮеҝөпјҡи°ғж•ҙзҪ‘з»ңеҸӮж•°пјҢдҪҝиҫ“еҮәжӣҙжҺҘиҝ‘зӣ®ж ҮеҖјгҖӮ

- иҝҮзЁӢпјҡ

1. д»Һиҫ“еҮәејҖе§ӢпјҢи®Ўз®—жҜҸдёӘиҠӮзӮ№еҜ№жңҖз»Ҳз»“жһңзҡ„еҪұе“ҚпјҢеҚіеҜјж•°гҖӮ

2. дҪҝз”Ёй“ҫејҸжі•еҲҷпјҲChain Ruleпјүз®ҖеҢ–еҜјж•°и®Ўз®—пјҢжҠҠй—®йўҳеҲҶи§ЈжҲҗеӨҡдёӘе°ҸйғЁеҲҶеӨ„зҗҶгҖӮ

3. еӮЁеӯҳиҝҷдәӣеҜјж•°з”ЁдәҺжӣҙж–°еҸӮж•°гҖӮ

ж•ҙдҪ“жөҒзЁӢ

1. еүҚеҗ‘дј ж’ӯз”ЁжқҘйў„жөӢз»“жһңгҖӮ

2. еҸҚеҗ‘дј ж’ӯз”ЁжқҘи°ғж•ҙйў„жөӢз»“жһңдёҺзңҹе®һз»“жһңд№Ӣй—ҙзҡ„е·®и·қгҖӮ

йҖҡиҝҮиҝҷз§Қж–№ејҸпјҢзҘһз»ҸзҪ‘з»ңйҖҗжёҗеӯҰд№ еҰӮдҪ•жӣҙеҮҶзЎ®ең°еҒҡеҮәйў„жөӢгҖӮ

Published at

2024-10-09 22:52:45Event JSON

{

"id": "b96374534bfc815a594997ec518746b6e1a42f721fbf06e8b1a0edabdc635e98",

"pubkey": "eae0b3874ec14c27f722e7b10600c41e5839e2d8562c15d414441015dc0f9bf3",

"created_at": 1728514365,

"kind": 1,

"tags": [],

"content": "и§Јз ҒзҘһз»ҸзҪ‘з»ңи®ӯз»ғпјҡж·ұе…ҘзҗҶи§ЈеүҚеҗ‘дёҺеҸҚеҗ‘дј ж’ӯзҡ„еҘҘз§ҳ\n\nиҝҷеј еӣҫи§ЈйҮҠдәҶзҘһз»ҸзҪ‘з»ңжҳҜеҰӮдҪ•и®ӯз»ғзҡ„пјҢз®ҖеҚ•жқҘиҜҙе°ұжҳҜйҖҡиҝҮеүҚеҗ‘дј ж’ӯе’ҢеҸҚеҗ‘дј ж’ӯдёӨдёӘжӯҘйӘӨжқҘе®ҢжҲҗзҡ„гҖӮ\n\n еүҚеҗ‘дј ж’ӯпјҲForward Passпјү\n- жҰӮеҝөпјҡи®Ўз®—иҫ“еҮәз»“жһңгҖӮ\n- иҝҮзЁӢпјҡ\n 1. иҫ“е…ҘпјҲx, y, zпјүйҖҡиҝҮдёҖзі»еҲ—и®Ўз®—жӯҘйӘӨгҖӮ\n 2. жҜҸдёҖжӯҘз”Ёз®ҖеҚ•зҡ„ж•°еӯҰж“ҚдҪңпјҢжҜ”еҰӮд№ҳжі•гҖӮ\n 3. еҫ—еҲ°жңҖз»Ҳиҫ“еҮәгҖӮ\n\n еҸҚеҗ‘дј ж’ӯпјҲBackward Passпјү\n- жҰӮеҝөпјҡи°ғж•ҙзҪ‘з»ңеҸӮж•°пјҢдҪҝиҫ“еҮәжӣҙжҺҘиҝ‘зӣ®ж ҮеҖјгҖӮ\n- иҝҮзЁӢпјҡ\n 1. д»Һиҫ“еҮәејҖе§ӢпјҢи®Ўз®—жҜҸдёӘиҠӮзӮ№еҜ№жңҖз»Ҳз»“жһңзҡ„еҪұе“ҚпјҢеҚіеҜјж•°гҖӮ\n 2. дҪҝз”Ёй“ҫејҸжі•еҲҷпјҲChain Ruleпјүз®ҖеҢ–еҜјж•°и®Ўз®—пјҢжҠҠй—®йўҳеҲҶи§ЈжҲҗеӨҡдёӘе°ҸйғЁеҲҶеӨ„зҗҶгҖӮ\n 3. еӮЁеӯҳиҝҷдәӣеҜјж•°з”ЁдәҺжӣҙж–°еҸӮж•°гҖӮ\n\n ж•ҙдҪ“жөҒзЁӢ\n1. еүҚеҗ‘дј ж’ӯз”ЁжқҘйў„жөӢз»“жһңгҖӮ\n2. еҸҚеҗ‘дј ж’ӯз”ЁжқҘи°ғж•ҙйў„жөӢз»“жһңдёҺзңҹе®һз»“жһңд№Ӣй—ҙзҡ„е·®и·қгҖӮ\n\nйҖҡиҝҮиҝҷз§Қж–№ејҸпјҢзҘһз»ҸзҪ‘з»ңйҖҗжёҗеӯҰд№ еҰӮдҪ•жӣҙеҮҶзЎ®ең°еҒҡеҮәйў„жөӢгҖӮ https://pbs.twimg.com/media/GZezdRsaAAMlpYY.jpg",

"sig": "37e2524fb297c0aff000798570517a0bb17712fa8a96fe0cdeb83a64baa59cf1ab25a3f831c9f3147f0f624282cf4ef3eb4325f8be9a193eac701daa7cd35c5b"

}